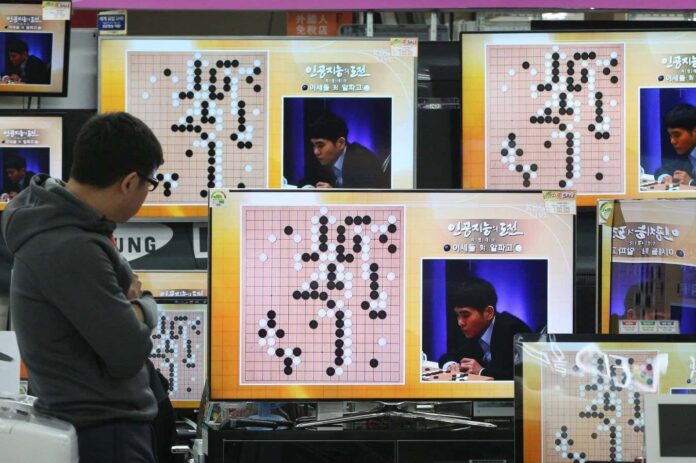

Dez anos atrás, o mundo assistiu em silêncio atordoado enquanto o AlphaGo do Google DeepMind derrotava Lee Sedol, um dos maiores jogadores de Go da história. Esta não foi apenas mais uma IA derrotando um humano; foi um momento decisivo que revelou um novo tipo de inteligência. A vitória provocou uma reação visceral, com o próprio Lee Sedol admitindo que estava “em choque” com os movimentos intuitivos e às vezes inexplicáveis da IA.

A inovação: redes neurais e intuição

O sucesso do AlphaGo baseou-se em redes neurais – modelos matemáticos complexos inspirados no cérebro humano. Ao contrário dos programas de jogos tradicionais que dependem de regras pré-programadas, o AlphaGo aprendeu a jogar. Fez isso analisando milhões de jogos reais e depois, o que é crucial, jogando mais milhões contra si mesmo. Esse jogo autônomo permitiu que a IA descobrisse estratégias além da compreensão humana.

Como observou na época Sergey Brin, cofundador do Google, o AlphaGo exibia “intuição”, realizando “belos movimentos” que até os humanos teriam dificuldade em conceber. Isto não foi mero cálculo; foi uma nova forma de reconhecimento de padrões que ultrapassou a capacidade humana. O jogo Go, com suas impressionantes 10171 posições possíveis, forneceu o caso de teste perfeito.

Do impacto ao mundo real

O legado do AlphaGo vai muito além do jogo de tabuleiro. A tecnologia subjacente foi aplicada a campos críticos como biologia e matemática. Mais notavelmente, AlphaFold, outra IA da DeepMind, revolucionou a previsão da estrutura de proteínas, rendendo aos seus criadores o Prêmio Nobel de Química. Mais recentemente, o AlphaProof alcançou a medalha de ouro na Olimpíada Internacional de Matemática, demonstrando a crescente aptidão da IA para o raciocínio complexo.

O princípio central que impulsiona esses sucessos é consistente: alimentar uma rede neural com grandes quantidades de dados e definir métricas claras para o sucesso. No Go, era ganhar o jogo; no enovelamento de proteínas, previa com precisão estruturas moleculares; em matemática, era resolver problemas de nível olímpico.

O processo de duas etapas: pré-treinamento e aprendizado por reforço

O método por trás desse sucesso envolve duas etapas principais: pré-treinamento e aprendizado por reforço. Primeiro, a rede neural é exposta a enormes conjuntos de dados (jogos Go, internet, literatura científica). Em seguida, ele refina seu desempenho por meio de tentativa e erro. Para o AlphaGo, isso significava jogar contra si mesmo; para AlphaFold, significou aprender a reconhecer proteínas dobradas corretamente; para grandes modelos de linguagem como ChatGPT, significa otimizar respostas com base no feedback humano ou na autocorreção.

O problema da caixa preta

Apesar destes avanços, permanece um desafio fundamental: as redes neurais são em grande parte opacas. Mesmo os engenheiros que construíram o AlphaGo não conseguiram explicar completamente por que ele executou certos movimentos, como o infame movimento 37, que inicialmente parecia irracional, mas acabou se revelando brilhante. Essa natureza de “caixa preta” significa que muitas vezes não sabemos por que uma IA chega a uma determinada conclusão, levantando preocupações sobre confiabilidade e confiabilidade.

Como observa Pushmeet Kohli, do Google DeepMind: “Esses modelos apresentarão respostas e não saberemos se são insights geniais ou alucinações”. Resolver isso continua sendo um foco central da pesquisa em andamento.

O futuro da IA: onde reinam os dados e a definição

O legado do AlphaGo não consiste apenas em derrotar um humano no Go. Trata-se de provar o poder das redes neurais e estabelecer as bases para aplicações de IA que estão transformando a ciência e a tecnologia. As áreas onde a IA está prosperando hoje – matemática, programação e campos com dados abundantes e verificáveis – destacam uma lição importante: o progresso requer dados e definições claras de sucesso. A próxima década promete avanços ainda mais dramáticos, mas compreender as limitações destes sistemas será tão crucial como celebrar as suas conquistas.